En fecha reciente, 16 de junio de 2023, el Parlamento Europeo votó a favor de aprobar el texto de la Ley de Inteligencia Artificial (IA) de la UE. Y el pasado viernes (8 de diciembre) el Parlamento Europeo, la Comisión Europea y los representantes de los Estados miembros en el Consejo Europeo, han pactado las primeras reglas para limitar los riesgos de la IA.

Este acuerdo pionero, recoge aspectos como definiciones y alcance de los sistemas de IA para distinguirlos de los sistemas de software más simples, además de delimita la competencia material, objetiva y territorial de la aplicación de estas normas e introduce una clasificación de los riesgos y un sistema sancionador.

Esta regulación contempla que no se aplicará a áreas fuera del alcance de la legislación de la UE y no afectará a las competencias de los Estados miembros en materia de seguridad nacional. Además, quedará excluido de su alcance los sistemas que se utilicen exclusivamente con fines militares o de defensa a los sistemas de IA utilizados con el único fin de investigación e innovación, ni tampoco a las personas que utilizan la IA por motivos no profesionales.

Se ha regulado una clasificación de los riesgos que llevan aparejados una serie de requisitos y obligaciones para que la IA acceda al mercado de la UE y por supuesto sanciones en caso de incumplimiento. El acuerdo recoge la prohibición de determinadas herramientas de IA y de alto riesgo con excepciones a esa prohibición cuando exista una necesidad por parte de las autoridades encargas de hacer cumplir la ley, entre estas prohibiciones que se consideran “inaceptables” se encuentra la manipulación cognitivo-conductual, la eliminación no selectiva de imágenes faciales de Internet o imágenes de CCTV, el reconocimiento de emociones en el lugar de trabajo y en instituciones educativas, la puntuación social, la categorización biométrica para inferir datos sensibles, como la orientación sexual o la religión. La normativa contempla otras herramientas de IA que por su riesgo limitado las obligaciones principalmente serán de trasparencia y con menos requisitos.

Para conocer en profundidad dichas normas, habrá que esperar al texto transaccional que se espera para las próximas semanas y que deberá ser confirmado.

Este acuerdo es el resultado, de una andadura que la Unión Europea, consciente de las importantes y trascendentes implicaciones de la IA, emprendió en el año 2017 con un informe del Comité de asuntos legales del Parlamento Europeo, que reconoció la necesidad de regular el uso de la IA.

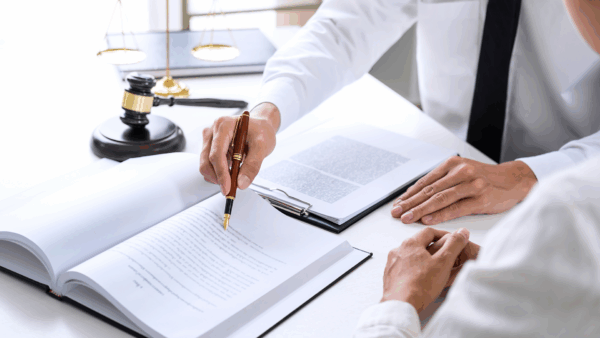

En diciembre de 2018, se aprobó por la Comisión Europea para la eficiencia de la Justicia la carta europea sobre el uso ético de la inteligencia artificial en los sistemas judiciales y su entorno. Que recoge los siguientes principios:

1. Principio de respeto de los derechos fundamentales: Asegurar que el diseño y la implementación de Las herramientas y servicios de inteligencia artificial son compatibles con los derechos fundamentales.

2. Principio de no discriminación: específicamente prevenir el desarrollo o la intensificación de cualquier discriminación entre individuos o grupos de individuos.

3. principio de calidad y seguridad: con respecto al procesamiento de decisiones judiciales y datos, usar fuentes certificadas y datos intangibles con modelos concebidos en un sistema multidisciplinario de manera, en un entorno tecnológico seguro.

4. Principio de transparencia, imparcialidad y equidad: hacer métodos de procesamiento de datos accesible y comprensible, autorice auditorías externas.

5. Principio "bajo control del usuario": Precluya un enfoque prescriptivo y asegúrese de que los usuarios estén actores informados y en control de sus elecciones.

Es indiscutible que la inteligencia artificial (IA) a la que ya se la denomina “cuarta revolución industrial” nos abre las puertas a un mundo que hasta hace bien poco nos parecía de ciencia ficción. El uso de la IA en los ordenamientos jurídicos del mundo entero ya es una realidad.

Así pues, en diversos estados de EE. UU., se emplea la herramienta de inteligencia artificial conocida como “COMPAS”(Correctional Offender Managment Profiler for Alternative Sanctions), que realiza una valoración del riesgo de reincidencia. En Argentina, en concreto en Buenos Aires, se ha desarrollado una herramienta denominada PROMETEA que emplea un aprendizaje automático para identificar patrones y emitir una decisión o predicción jurídica sobre una base estadística, así como otras funciones más simples como un sistema de cómputo de plazos.

En el ámbito de la prevención delictiva, proliferan los software con fines asistenciales y de colaboración con la investigación criminal como son DATA MINING prevé dónde conseguir posibles indicios delictivos, ADVOKATE predice idoneidad o fiabilidad de los testigos y STEVIE permite reconstruir una historia. En Chicago se utiliza la herramienta PREPOLD, en Nueva York la conocida CompStat, en Filadelfia la llamada HunchLab, para determinar geográficamente puntos de riesgo. En el Reino Unido se utiliza la herramienta HART (Harm Assesment Risk Tool), para predecir el riesgo de comisión de delitos en un periodo de dos años.

En nuestro país, en julio de 2017 se puso en funcionamiento el Sistema VioGén (Sistema de Seguimiento Integral en los casos de Violencia de Género) que entre sus objetivos esta la predicción del riesgo, seguimiento y protección de las víctimas. En el año 2015 empezó a probarse en el ámbito de la Policía Nacional la aplicación informática VeriPol que pretende detectar denuncias falsas. Y un caso de éxito es la automatización de la cancelación de antecedentes penales, que se emplea desde 2021 y que según información del ministerio de justicia “en una sola semana, se cancelaron 142.000 causas, equivalente al trabajo de un funcionario a tiempo completo durante 5 años”.

Las bondades de la IA que aporta celeridad, eficiencia, reducción de costes y unificación de criterios, pueden contribuir a mejorar la tan mermada imagen de la Justicia en nuestro país y contribuir a la eficacia de la labor de la Policía y Guardia Civil, mediante el uso de mapas criminales, algoritmos predictivos etc. para la prevención del delito. Sin embargo, muchas voces alertan de los importantes riesgos éticos y jurídicos, en relación con el uso de esta tecnología, que puede afectar a los sesgos y discriminación algorítmica, a un uso no autorizado de datos, a la privacidad, a la falta de trasparencia, a la libertad de expresión, a la seguridad jurídica etc. Además, de que un mal uso de esta, puede dar lugar a permitir el acceso incontrolado de los datos personales o a una vigilancia masiva de las personas sin el consentimiento o conocimiento de las personas.

Uno de los casos más controvertidos es el caso Loomis en 2013, que abrió en EE. UU el debate entre la preponderancia entre el derecho de autor y propiedad inmaterial de la empresa creadora de la herramienta COMPAS y el derecho del condenado a ejercitar el derecho de defensa.

Y como último caso reciente, en junio de 2023 ha sido la condena de un Juez americano a dos abogados por presentar un escrito judicial utilizando la popular herramienta ChatGPT que se inventó unos precedentes legales inexistentes.

La IA forma parte ya de nuestras vidas y la regulación de su uso se ve como algo necesario y fundamental para realizar un buen uso de ella. España, ha tomado la delantera y ya ha creado la Agencia Estatal que se contempla en la Estrategia Nacional de Inteligencia Artificial (AESIA) que gozará de autonomía, independencia, patrimonio propio y de potestades administrativas. El Estatuto de AESIA fue aprobado el pasado 22 de agosto de 2023, cuya sede está en la Coruña y llevará a cabo tareas de supervisión, el asesoramiento, la concienciación y la formación dirigidas a entidades de derecho público y privado para la adecuada implementación de toda la normativa nacional y europea en torno al adecuado uso y desarrollo de los sistemas de inteligencia artificial, más concretamente, de los algoritmos.

En un futuro inmediato podremos comprobar si todas estas medidas son suficientes para afrontar los retos del progreso y avance de la IA, que nos llevarán a buen seguro a introducir nuevas modificaciones en nuestro ordenamiento jurídico.

Pd. El título de este post ha sido redactado con IA.